Mūsdienās dziļviltojumi (deepfakes – angļu val.) pieredz sprādzienveida attīstību. Varētu pat teikt, ka mēs esam liecinieki digitālo tehnoloģiju revolūcijai, kas mūsu dzīvi tuvākajā nākotnē mainīs līdz nepazīšanai. Līdz ar mākslīgā intelekta (MI) tehnoloģijas straujo attīstību būtiski pieaugušas līdz šim plašākai sabiedrībai nepieredzētas iespējas tā sauktā mākslīgi veidotā jeb sintētiskā satura (audio, video un attēli) radīšanai. Sintētisko saturu var izmantot gan labiem, gan ļauniem mērķiem, un MI straujā attīstība un pieejamība aktualizē nopietnus jautājumus, tostarp – kur ir robeža starp radošām izpausmēm un maldināšanu. Kā pārvarēt izaicinājumus, ko rada sintētiskā satura izplatīšana? Dažādas manipulācijas, attīstītas krāpšanas metodes, kā arī nesenais Izraēlas–Hamās karš informatīvajā telpā jau pierādījis, ka Pandoras lāde ir atvērta. Galvenais jautājums: vai mēs tam esam gatavi?

Jābūt gataviem tagad, jo tas notika jau vakar

Šobrīd tehnoloģijas rada tik pirmšķietami ticamu sintētisko materiālu, ka to atšķirt no īsta satura ir ļoti grūti. Izšķirošs faktors ir tikai tas, cik daudz finanšu līdzekļu un laika iespējamais manipulators ir gatavs ieguldīt, lai izstrādātu dziļviltojumu, kas apmānīs ja ne visus, tad vismaz lielu daļu auditorijas. Piemēram, Apvienotajā Karalistē veikts pētnieciskais tests liecina, ka pat situācijā, kad cilvēki ir informēti un zina, ka tas, ko viņi redzēs, iespējams, būs viltojums, tikai 15% varēja pareizi atminēt “īsts vai viltots” 6 no 8 gadījumiem, bet vairākums aptaujāto spēja atpazīt mazāk nekā pusi gadījumu.

Tādēļ nesenie gadījumi, kad atsevišķi Latvijas politiķi iekļuva manipulatoru izliktajās lamatās, nav pārsteidzoši vai unikāli. Vienlaikus tie izgaismoja mūsu sabiedrības ievainojamības, kam jāpievērš nopietna uzmanība, lai tās mazinātu. Lai arī jau 2021. gadā Saeimas deputāti uzķērās uz dziļviltojumu, tas nenozīmē, ka amatpersonas kopš tā laika ieguvušas neatgriezenisku imunitāti vai ka līdzīgi gadījumi neatkārtosies nākotnē. Lielā mērā to nosaka apstāklis, ka maldināšana un manipulēšana ar dziļviltojumiem strādā pēc līdzīgas shēmas kā parasta krāpšana. Lai arī, sekojot līdzi jaunu rīku attīstībai, pastāvīgi tiek novērsti dažādi tehnoloģiski trūkumi, potenciālie krāpnieki izmanto cilvēciskās vājības, tostarp mūsu neuzmanību, iegrimšanu ikdienas rutīnā, nespēju indivīdu līmenī pietiekami ātri “aklimatizēties” jeb pielāgoties.

Piemēram, kopš 2020. gada, kad daudzi pandēmijas iespaidā pārgāja uz attālināto darbu un tiešsaistes sanāksmēm, tā nereti ir visai ikdienišķa un normalizēta situācija, ka kādam dalībniekam ir vājš interneta signāls, kā rezultātā videozvana laikā “raustās” vai “sastingst” skaņa vai attēls. Lieliski! Tieši to kā aizsegu izmanto krāpnieki dziļviltojuma tehnoloģiju nepilnību, ja tādas pastāv, noslēpšanai. Piemēram, bijušais Latvijas Ministru prezidents Krišjānis Kariņš, tāpat kā vēl virkne citu Eiropas politisko līderu, uzķērās uz Krievijas tā saukto “pranksteru” operāciju, kas maldināšanai reāllaikā izmantoja zagtu kādas Āfrikas Savienības amatpersonas identitāti. Šīs “izjokošanas” pamatā bija apgrūtināta personas identitātes drošticama pārbaude (lasi vairāk par šo gadījumu mūsu rakstā “Hahaganda” – kad slikts joks kļūst par dezinformācijas ieroci).

Jāapzinās, ka tehnoloģijas attīstās, manipulatori tām pielāgojas, bet ievainojamības indivīda līmenī lielā mērā saglabāsies vai tiks mazinātas lēnām, tādēļ līdzīgi gadījumi var atkārtoties arī turpmāk.

Krāpšana, šantāža un informatīvais karš

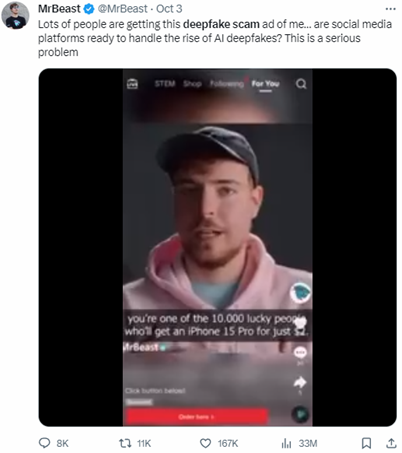

Kā to varēja paredzēt, pēdējā gada laikā dziļviltojumu tehnoloģija politiskajā un sociāli ekonomiskajā jomā ir demonstrējusi arī kaitniecisko ietekmi, tostarp spēju izkrāpt naudu un datus, šķelt sabiedrību, polarizēt viedokļus. Visbiežāk varam novērot gadījumus, kad MI tehnoloģijas tiek izmantotas un pielāgotas dažādām krāpšanām, tostarp pikšķerēšanai vai klikšķu “medīšanai”. Piemēram, pasaulslavenais YouTube videoblogeris Mr. Beast kļuva par upuri identitātes zādzībai, ko tālāk izmantoja krāpnieku klikšķu medību reklāmās, potenciālajiem upuriem piesolot bezmaksas iPhone. Citā gadījumā tika ekspluatētas vairāku Holivudas aktieru identitātes, reklamējot it kā pieejamu naudas izmaksu no ASV valdības iestādēm, izkrāpjot upuru personīgos datus.

Par nopietnu problēmu kļuvusi šantāža ar manipulētiem attēliem gadījumos, kad noziedznieki rada audiovizuālo saturu, kas potenciālo krāpšanas upuri parāda neglaimojošā vai apkaunojošā situācijā. Bieži tie ir sintētiski pornogrāfiska rakstura attēli vai video, ko izmanto, lai izspiestu naudu, pretējā gadījumā solot tos publicēt internetā. Par šāda veida izspiešanas upuriem ASV jau kļuvuši tūkstošiem cilvēku, bieži vien nepilngadīgie.

Sintētiskais saturs nereti tiek izmantots, lai grautu uzticēšanos vai diskreditētu arī politiskos aktīvistus. Piemēram, Twitter/X platformā simtiem tūkstošu skatījumu ieguva dziļviltojums, kurā redzama klimata aktīviste Grēta Tūnberga, it kā sniedzot interviju kādā TV kanālā. Lai gan ātri vien video tika atmaskots, tomēr tā kaitnieciskās sekas bija redzamas vēl vairākas dienas pēc tā sākotnējās publicēšanas, jo to atkārtoti publiskoja, lai nomelnotu pašu G. Tūnbergu vai klimata aktīvistus kā grupu. Atšķirībā no pirmā ieraksta no jauna pārpublicētajiem video nebija pievienotas Twitter/X “Kopienas piezīmes”, kas saturētu atspēkojumu, kas ir teju vienīgais veids, kā Twitter/X lietotāji var paši cīnīties ar dezinformāciju vai maldināšanu šajā platformā.

Būtiskas bažas rada gadījumi, kad ar MI radītas dezinformācijas palīdzību tika mēģināts ietekmēt 2023. gadā notikušās Slovākijas parlamenta vēlēšanas. Līdzās citām jau ierastām informācijas manipulācijas metodēm divas dienas pirms vēlēšanām Facebook platformā parādījās audioieraksts, kurā vēlēšanu kandidāti it kā apsprieda iespējamu vēlētāju balsu pirkšanu. Sīvā priekšvēlēšanu cīņā šādiem mākslīgi radītiem un, ļoti iespējams, neīstiem incidentiem var izrādīties izšķiroša nozīme, ietekmējot demokrātiskos procesus un indivīdu politiskās izvēles. Nesen viltots audioieraksts parādījās arī par Lietuvas ārlietu ministru Gabrielu Landsberģi, kas, iespējams, kalpoja kā viens no pirmajiem signāliem sabiedrības testēšanai pirms 2024. gada maijā gaidāmajām Lietuvas Valsts prezidenta vēlēšanām.

Dziļviltojumus plaši izmanto arī informatīvajā karā, kas ir daļa no Krievijas pilna apmēra iebrukuma Ukrainā. Liela daļa no tiem gan nav pārāk sekmīgi. Tā vietā, lai sasniegtu stratēģiskos mērķus kaujas laukā vai mainītu auditoriju uzvedību, tie nereti kalpo par pedagoģisku mācībstundu plašākai sabiedrībai, izglītojot par šāda veida apdraudējumiem un stiprinot sabiedrības noturību pret līdzīgu metožu izmantošanu nākotnē.

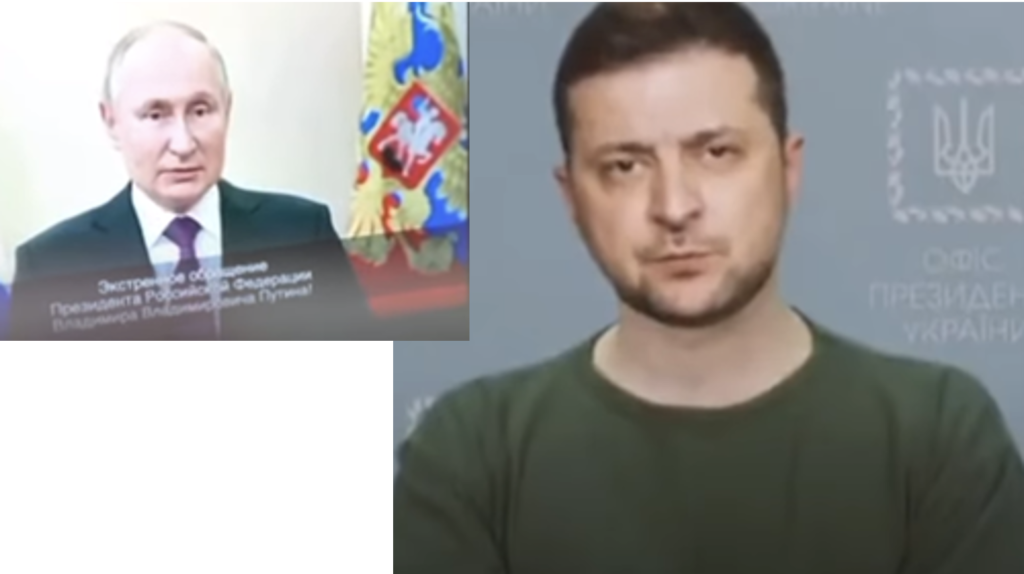

Īpaši izplānotā operācijā neilgi pēc Krievijas iebrukuma Ukrainā sākuma Krievijas hakeri 2022. gada 16. martā uzlauza kāda Ukrainas medija mājaslapu, ievietojot tajā video, kurā it kā redzams Ukrainas prezidents Volodimirs Zelenskis, kurš aicina ukraiņus nolikt ieročus un pārstāt pretošanos iebrucējiem. Viltojums tika ātri atmaskots un atspēkots, un, kā atzinuši eksperti, tas bijis sagatavots tik sliktā kvalitātē, ka dziļviltojuma vietā tas drīzāk būtu dēvējams par “lētviltojumu” (cheap-fake – angļu val.). Ukraiņi uzreiz atpazina, ka video nav īsts, jo sintētiski radītajā materiālā bijusi nepārliecinoša attēla kvalitāte un gramatiski slikta ukraiņu valoda. Arī ukraiņi atbildēja Krievijas auditorijām ar līdzīgu metodi 2023. gada 5. jūnijā, izplatot video dziļviltojumu par Vladimiru Putinu, kurā Krievijas diktators it kā pasludina karastāvokli un vēl vienu mobilizācijas vilni Krievijā, kas ir potenciāli ļoti nepopulāri lēmumi plašākā Krievijas sabiedrībā.

Pēdējos mēnešos Izraēlas-Hamās karā dezinformācijas pētnieki un plašāka sabiedrība pieredzēja sintētiski radītu informācijas manipulāciju izmantošanas sprādzienu. Karā emocijas sit augstu vilni, un tas ir lielisks fons, lai dziļviltojumi nostrādātu, sasniedzot to radītāju mērķus. Šādos apstākļos sabiedrībā ir milzīgs pieprasījums pēc informācijas, kā rezultātā pat sliktas kvalitātes viltojums ar spēcīgu emocionālo vēstījumu var radīt paniku, viest šaubas vai sasniegt citu efektu. Piemēram, pēc Izraēlas gaisa spēku veiktās Gazas sektora bombardēšanas sociālo mediju platformās sāka cirkulēt daudzi MI ģenerēti attēli, kas radīja spēcīgu emocionālo ietekmi uz auditorijām gan konflikta reģionā, gan plašākā pasaulē, veicinot politiskās un sociālās domstarpības, cenšoties kurināt naidu. Attēli pat ar salīdzinoši sliktas kvalitātes dziļviltojumiem pēc to sākotnējas publicēšanas sociālajos medijos tika izmantoti arī kā plakāti protesta demonstrācijās, pierādot MI radītā satura lielo potenciālu sabiedriskās domas un konfliktu eskalācijas ietekmēšanai.

Vienlaikus sintētiski radītas manipulācijas var tikt izplatītas arī rafinētā veidā. Bieži šāds saturs nemaz netika pasniegts kā īsts, tas slēpās zem “mākslas” jeb cilvēka mākslinieciskās izpausmes birkas, kalpojot kā ilustrējošs vizuālais materiāls zem ierakstiem sociālo mediju platformās. Piemēram, ieraksta autors nemaz necentās apgalvot, ka tas ir īsts mazulis gruvešos, kuram neprasmīgi uzģenerētas rokas vai plaukstām ir seši pirksti. Vai šādi gadījumi ir vērtējami kā dezinformācija? Šajā kontekstā būtiski ir vērtēt ziņas izplatītāja uzvedību un nolūkus, tostarp, piemēram, vai ir identificējamas pazīmes neautentiskai un koordinētai satura izplatīšanai.

Ko darīt, lai mazinātu MI ļaundabīgo ietekmi?

Lielu lomu spēlē indivīdu un sabiedrības spēja adaptēties jauno tehnoloģiju ienākšanai mūsu ikdienā, tostarp prasmes atpazīt potenciāli manipulētu saturu no autentiska, kā arī lielāka paškontrole attiecībā uz savu uzvedību, saskaroties ar emocionāli ļoti spēcīgu un pielādētu saturu tiešsaistē. Tāpat būtisku lomu spēlē pašu sociālo mediju uzņēmumu spēja izkontrolēt kaitnieciskas darbības savās platformās, tostarp savlaicīgi identificēt aizdomīgas darbības un saturu, ko tās pašas ir aizliegušas, kā arī apturēt un ierobežot tā tālāku izplatību – jo īpaši laikā, kad notiek vēlēšanas, katastrofas, kari vai citi spēcīgi satricinājumi.

Šis ir pirmais raksts plašākā sērijā veltītai dziļviltojumiem, to ietekmei, radītajiem draudiem valstīm un sabiedrībai, to atpazīšanai un metodēm, lai mazinātu riskus savā ikdienā. Nākamajā rakstā analizēsim dažādas stratēģijas dziļviltojumu apkarošanai, aplūkojot, kādas ir ekspertu un sabiedrības ekspektācijas un iespējas šajā nepārtrauktajā digitālās drošības cīņā.

Atceries par iespēju ziņot par manipulācijām informatīvajā telpā vietnē www.melnsuzbalta.lv!