Mēs dzīvojam laikmetā, kad tehnoloģiju attīstība nemitīgi pārveido mūsu dzīves. Rakstu sērijas pirmajā daļā jau izstāstījām, kā tehnoloģija spēj radīt maldinošu saturu. Šoreiz vēršam uzmanību uz jautājumiem par cilvēku uztveri, sociālo mediju politiku un dziļviltojumu identificēšanas iespējām – jomām, kurās katru dienu tiek sapludinātas robežas starp reālo un izdomāto.

Cilvēku uztvere un “asā vara”

Arvien pieaugošā digitālo mediju klātbūtne ir mainījusi to, kā uztveram un patērējam informāciju. Cilvēki aizvien vairāk pievēršas vizuālajam saturam – video un attēliem, kas ir vieglāk uztverami un ātrāk nodod ziņu satura patērētājam. Rezultātā veidojas paradoksāla situācija, kurā sociālo mediju ierakstam tiek veltīts arvien mazāk laika, bet kopējais satura patērēšanas laiks sociālo mediju platformā pieaug. Nesen veiktā “Tele 2” un “Norstat” pētījumā atklāts, ka 65% Latvijas iedzīvotāju sociālajos medijos pavada aptuveni divus stundas dienā. Tas nozīmē, ka, nemainoties šiem paradumiem, vidējais latvietis pie pašreizējās situācijas sociālajos medijos pavada 5 gadus no sava mūža.

Tieši sociālo mediju platformas ir galvenās dziļviltojumu izplatīšanas vietas. Tāpat kā sabiedrība kopumā, arī sociālie mediji saskaras ar lieliem izaicinājumiem, kā līdzsvarot vārda un izpausmes brīvību ar sabiedrības pieprasījumu mazināt apdraudējumus un iespējamo kaitējumu. Dezinformatori, krāpnieki un citi manipulatori darbojas pelēkajā zonā, sistemātiski un mērķtiecīgi integrējot savus “produktus” ziņu plūsmās, kuras Latvijas iedzīvotāji labprāt patērē.

Nekur nav pazudusi arī cilvēku tieksme dot priekšroku uzskatiem un viedokļiem, kas atbilst katra indivīda pasaules redzējumam, neraugoties uz to, vai tie ir aplami vai patiesi. Turklāt sociālo mediju algoritmi būvēti tā, lai pieskaņotu katram vistīkamāko un saistošāko saturu. Šos faktorus izmanto gan dezinformatori, gan negodprātīgi uzņēmēji, lai ar tehnoloģiski iespējotiem un precīzi nomērītiem paņēmieniem piegādātu emocionāli pielādētu viltojumu pareizajā mirklī.

Daudzi būs dzirdējuši par tā saukto “maigās varas” (soft power – angļu val.) konceptu, kas nosaka, ka valstis maina citu valstu uzvedību sev par labu ar pievilkšanas spēku, izmantojot tādus līdzekļus kā, piemēram, sports, mūzika un kultūra plašākā kontekstā. Šodien tehnoloģiju straujā attīstība dod nepieciešamos instrumentus, lai mūsdienu konfliktos starp valstīm, uzņēmumiem, organizācijām tiktu pielietotas stratēģijas un taktikas, ko dēvē par “aso varu” (sharp power – angļu val.). Atsevišķi pētnieki šo konceptu skaidro kā “maigās varas” neganto versiju – slēptu un pēc savas dabas ļoti agresīvu masu pārliecināšanas metodi, izmantojot savā labā datus, kā arī tehnoloģiju un digitālās vides lielo ietekmi uz cilvēku ikdienu. Tā var būt arī hibrīdkara metode, lai šķeltu pretinieka sabiedrību, polarizētu tās grupas un palielinātu tajā esošās plaisas, tādējādi sasniedzot savus militāros vai politiskos mērķus, piemēram, ietekmējot citas valsts vēlēšanas atbilstoši savām interesēm.

Dziļviltojumu identificēšana… labu ziņu vēl nav!

Līdz ar mākslīgā intelekta (MI) rīku veiktspējas attīstību arvien pieaug pieprasījums pēc rīkiem, kas spēs MI radītos materiālus identificēt. Diemžēl līdzšinējie risinājumi nav bijuši pārāk sekmīgi, lielā mērā tāpēc, ka pašidentificēšanas jeb kritizēšanas sistēma jau ir integrēta dziļviltojumu radīšanā.

Dziļviltojumu ģenerēšana darbojas pēc GAN struktūras (generative adversarial network – angļu val.), kurā notiek pastāvīga mijiedarbība starp satura ģenerētāju un pārbaudītāju (diviem mākslīgiem neironu tīkliem).

Darbs tandēmā notiek tik ilgi, līdz ģenerētājs ir attīstījis savu “produktu” tādā pakāpē, ka pārbaudītājs vairs neredz nepilnības. Vēl viena sevis pārbaudes jeb “kritizēšanas” slāņa pievienošana neko daudz nemaina, jo arī atkārtota pārbaude var tikt apmānīta.

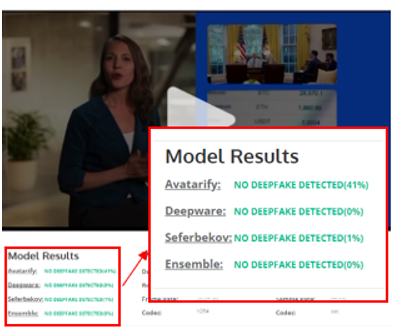

Jau šobrīd ir pieejami dažādi brīvpieejas rīki, kas pārāk bieži nespēj identificēt viltojumu. Ja arī rīkam izdotos viltojumu identificēt, tā paveikšanai ir vajadzīgi vairāki soļi, piemēram, nepieciešams lejuplādēt video, izgriezt gabaliņu no tā, lai netiktu pārsniegts augšupielādes limits, tad doties uz speciālu mājaslapu, lai to atkal augšupielādētu. Pēc tam lietotājam ir jāgaida vairākas minūtes, līdz analīzes rīks izanalizē septiņu sekunžu materiālu. Ikdienas sociālo mediju lietotājam tās ir pārāk daudzas un, iespējams, sarežģītas darbības.

Lai identificētu un pārvarētu nepilnības, ko GAN vēl nespēj novērst, jāmeklē jauni analīzes rīki, tostarp tādi, kas spētu viltojumu atpazīt reāllaikā sociālo mediju lietotājam maksimāli ērtā veidā. Piemēram, tehnoloģiju gigants Intel ir radījis rīku, kas analizē video redzamo cilvēku un cenšas uztvert praktiski nepamanāmās izmaiņas ādas krāsā, ko rada asins cirkulācija cilvēka ķermenī. Tomēr arī šajā gadījumā ir riski, jo nepieciešams ļoti augstas izšķirtspējas videomateriāls. Savukārt līdzšinējā prakse liecina, ka dziļviltojumi bieži ir salīdzinoši zemas kvalitātes – tieši tāpēc, lai maskētu tajos esošās nepilnības. Arī BBC veiktais eksperiments ar Intel rīku apliecināja, ka tehnoloģija joprojām ir kļūdaina, tostarp arī autentiskus video apzīmējot kā viltojumus. Tehnoloģijas ieviešana, kas “skenētu” katru internetā pieejamo un sociālajos medijos publicēto video, šobrīd ir pārāk dārga, bet pieļautās kļūdas radītu reputācijas un uzticamības riskus. Būtisks bremzējošais faktors ir arī šādas tehnoloģijas ieviešanai nepieciešamo papildu skaitļošanas jaudu izmaksas.

Vēl viens iespējamais risinājums cīņai ar dziļviltojumiem ir verifikācijas sistēmas ieviešana, ko šobrīd izmēģina vairāki tehnoloģiju giganti. Tā paredz “iezīmēt” katru radīto un apstrādāto attēlu vai video jau metadatu līmenī ar konkrētām atzīmēm audiovizuālā materiāla “pasē”. Rezultātā jebkurš sociālo mediju lietotājs varētu redzēt, kur un ar kādu ierīci vai tehnoloģiju attēls vai video ir radīts. Līdzīga ideja paredz atzīmes attiecināšanu konkrēti uz MI ģenerētājiem, saturā pēc noklusējuma integrējot “ūdenszīmi”. Abos iespējamos risinājumos neiztikt bez ciešas sadarbības ar tehnoloģijas izstrādātājiem un sociālo mediju platformām, kurām marķēšana un pārredzamības funkcija būtu jānodrošina saviem lietotājiem. Diemžēl uz tik ciešas sadarbības modeli mums vēl ir jāgaida.

Sintētiskais saturs un sociālo mediju politika

Lielākajās sociālo mediju platformās jau tagad ir regulēta sintētiskā satura izmantošana. Piemēram, ir aizliegta ir šāda satura izmantošana ļaunprātīgos nolūkos, tostarp apzinātai maldināšanai un dezinformācijas izplatīšanai. Atsevišķos gadījumos sociālo mediju platformās jau ir noteikta sintētiskā satura īpaša marķēšana gadījumos, ja tāds tiek izmantots politiskajās reklāmās vai izmantota īstas personas identitāte. Piemēram, tehnoloģiju gigants Google saviem lietotājiem Indijā nesen ieviesis noteikumus, kas paredz iespēju pašiem atzīmēt jebkādu sintētisko saturu, ko tie izvieto Google platformās. Bet kopumā situācija ir diezgan slikta un nerada pārliecību, ka sociālo mediju platformas ir gatavas cīnīties ar apdraudējumiem, ko rada tehnoloģijas straujā attīstība. Par to liecina kaut vai tas, ka tikai TikTok ir iespēja parastam lietotājam ziņot par dziļviltojumu vai cita veida sintētisko saturu.

Arī lasot sociālo mediju noteikumus, ir redzams, ka pastāv ļoti plaša “pelēkā zona”, kurā iekļaujas sintētiskā satura lietošana. Tāpat ar dezinformāciju un maldināšanu ne vienmēr varēs skaidri noteikt, kur, piemēram, beidzas joki un izklaide un sākas maldināšana ar mērķi kādam nodarīt kaitējumu.

Pētnieki, kas analizējuši sociālo mediju platformu sintētiskā satura rīcībpolitikas, akcentē problēmas MI radītos tekstos, kas šobrīd netiek regulēti pašu sociālo mediju platformu lietošanas noteikumos. Vienlaikus šī ir relatīva problēma, jo pašlaik atšķirībā no video un attēliem precīzi identificēt MI radītu tekstu ir teju neiespējami.

Eksperiments MI radītu tekstu atpazīšanai un secinājumi

Problēmas pamatā ir sarūkošais teksta apjoma garums pie sociālo mediju ieraksta. Ja reiz platformu lietotāji lasa īsākus tekstus, tad arī satura veidotāji tam pielāgojas un veido īsākus ierakstus, vairāk fokusējoties uz audiovizuālo materiālu. To ietekmē arī iesaistes rādītāji. Visaugstākie lietotāju iesaistes rādītāji ir sociālo mediju ierakstiem līdz 80 zīmēm, kas ir gandrīz divas reizes mazāk zīmju nekā šajā teikumā. Tik mazs zīmju skaits sintētiskā satura identificēšanu padara neiespējamu.

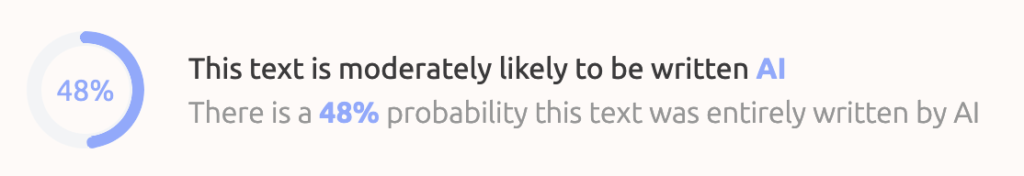

Lai to pierādītu, mēs veicām vienkāršu eksperimentu, dodot uzdevumu ChatGPT-4 uzrakstīt tekstu par MI un pēcāk izmēģinot vairākus brīvpieejas rīkus MI radītu tekstu identificēšanai.

Rezultāti nebija iepriecinoši. Tikai vienā no eksperimenta gadījumiem rīks spēja identificēt, ka tekstā ir teikums, kuru, iespējams, nav rakstījis cilvēks. Turklāt tekstu veidoja 2959 zīmes. Līdzko pārbaudei analītiskajam rīkam tika piedāvāts vēl mazāk zīmju, tas sintētisko saturu atpazīt vairs nespēja.

Eksperiments arī uzskatāmi parāda, kādēļ sociālo mediju platformu lietošanas noteikumos šādiem risinājumiem vismaz pagaidām netiek pievērsta uzmanība.

Diemžēl ir jāsamierinās, ka tuvākajā nākotnē lielāko daļu sociālo mediju tekstu rakstīs MI rīki, jo tas ir lēti un ātri, bet to identificēšana vai ierobežošana būs grūta vai teju neiespējama.

Mēs esam izpētījuši, kā digitālie mediji un MI tehnoloģijas ietekmē mūsu uztveri un informācijas patēriņu, radot jaunus izaicinājumus un paradoksus, bet ceļojums dziļviltojumu pasaulē nav beidzies. Noslēdzošajā sērijas rakstā mēs pievērsīsimies jautājumiem, kā sabiedrība un tehnoloģiju industrijas varētu risināt izaicinājumus, meklējot veidus, kā adaptēties un aizsargāt sevi pret maldinošu MI radītu saturu.

- Ar citiem šīs sērijas rakstiem vari iepazīties šeit: Dziļviltojumi: digitālās patiesības un sintētiskie maldi – I daļa (21.12.2023.).

- Atceries par iespēju ziņot par manipulācijām informatīvajā telpā vietnē www.melnsuzbalta.lv!