Dziļviltojumu (deepfakes – angļu val.) tehnoloģija ir attīstījusies no speciālistu eksperimentiem 90.gados līdz plašai publikai relatīvi brīvi un lēti pieejamu instrumentu klāstam. 2019. gadā zinātnieki pasaulei atklāja automātisko cilvēku seju sintezētāju “ThisPerson doesNotExist”, kas ģenerēja reālistiskus cilvēku seju attēlus. Sensāciju radīja video ar bijušā ASV prezidenta Baraka Obamas viltotu runu, kurā vēstīja par nākotnes izaicinājumiem dezinformācijā. Jau tobrīd nebija grūti paredzēt iespējamos drošības riskus, bet bažas mazināja apsvērums, ka tehnoloģija bija pieejama vien šauram speciālistu lokam, un iespēja, ka tā būs plaši izplatīta un viegli lietojama plašākā sabiedrībā, šķita vēl pārāk tāla.

Nākotne ir kļuvusi par tagadni. Šobrīd sintētisko saturu jau plaši izmanto, lai pelnītu, piemēram, radot izklaides saturu. Vienlaicīgi piepildījusies arī prognoze, ka “digitālā patiesība” var tikt izmantota maldināšanai. Piemēram, dalībai informatīvajā karā nav nepieciešams formastērps, ierocis vai valsts dots mandāts, jo par karotāju var kļūt ikviens, kas ar viedierīci ar interneta pieslēguma izvēlas radīt vai pielāgot reālistiskus foto attēlus un audiovizuālo materiālu. Bieži šādus produktus ir teju neiespējami atšķirt no īstiem, jo tehnoloģijas attīstība pēdējo divu gadu laikā ir bijusi fenomenāla.

No eksperimentiem laboratorijās līdz “Face swap” lietotnei telefonā

Šodien daudzi ir dzirdējuši par dziļviltojumiem un tādiem attēlu izveidošanas rīkiem kā Midjourney, DALL-E un Stable Diffusion, kas acumirklī pārvērš rakstu zīmes attēlos, vai par izmēģinājuši savās viedierīcēs lietotnes, kas ļauj cilvēkam video burtiski “nomainīt seju” vai iekustināt statisku portretu. Tehnoloģijas attīstības temps ir ļoti straujš, un, ja lietotājam ir arī minimālas programmēšanas iemaņas, tad tas jau paver plašas iespējas radīt kvalitatīvus, pilnībā sintētiskus video, kas pilnībā izmainīs gan filmu industriju, gan digitālā satura veidošanu kopumā.

Radīt monetizējamas “digitālās patiesības” ir racionāli, jo tirgus ekonomika un konkurence par iesaistes rādītājiem mudina meklēt veidus, kā optimizēt izmaksas. Profesionāļi, kas izmanto jaunākos rīkus, spēj piedāvāt arvien lētākus pakalpojumus, un apsviedīgi uzņēmēji jau aizstāj autentisku un iepriekš relatīvi dārgu saturu – īstus foto, mākslinieku un dizaineru gatavotus darbus, videomateriālus – ar sintētiski radītiem aizstājējproduktiem. Aizstāti tiek pat cilvēki.

Sintētiskie TikTok influenceri, kuri dejo un runā, pēc būtības nav problēma. Izaicinājumi var rasties brīdī, kad parādās sintētisks tiktokeris, kurš eksistē tikai digitālā vidē, neguļ, neēd, runā vairākās valodās, visu laiku ir tiešsaistē, lai izplatītu apzināti maldinātu, izplatot dezinformāciju un ietekmējot demokrātiskos procesus ar saturu par sociālo politiskām, ekonomiskām vai, iespējams, sensitīvām un sabiedrību polarizējošām tēmām. Principā tas ir iespējams jau šodien.

2024. gadā teju pusei planētas iedzīvotāju būs iespēja piedalīties vēlēšanās

2024. gads ir zīmīgs kā vēlēšanu gads, kad pie vēlēšanu urnām varētu doties vairāk nekā puse zemeslodes iedzīvotāju vairāk nekā 50 valstīs (4.2 miljardi cilvēku ar balsstiesībām). Tostarp no Latvijas skatupunkta būtiskas būs gan novembrī paredzētās ASV prezidenta vēlēšanas, gan Eiropas Parlamenta vēlēšanas jūnija sākumā, kas noteiks Eiropas Savienības tālāko virzību un attīstību. Ņemot vērā ģeopolitiskos saspīlējumus pasaulē un novērojumus informatīvajā telpā aizvadīto gadu laikā, var droši apgalvot, ka šogad redzēsim daudz mēģinājumu izmantot “sintētiskos maldus”, lai ietekmētu demokrātiskos procesus un vēlēšanu rezultātus.

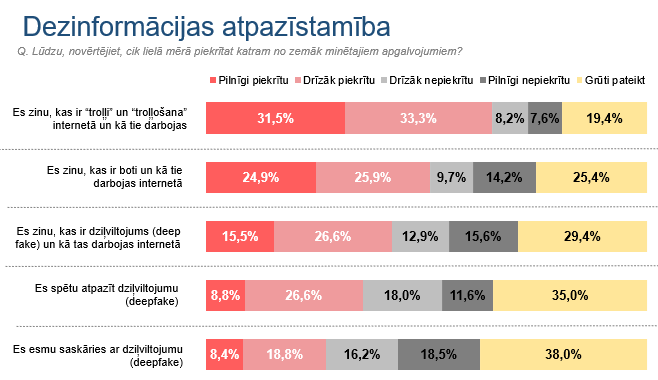

Centrālais elements, kā izskaust demokrātisko procesu ievainojamības un mazināt riskus vēlēšanām, ir vairot cilvēku zināšanas un prasmes tiem pretoties. Šajā gadījumā – zināšanas, kas ir dziļviltojumu, kā arī prasmes atpazīt ar to palīdzību veiktas manipulācijas informatīvajā telpā. 2023. gadā oktobrī un novembrī Valsts kancelejas uzdevumā veikts “Berg Research” socioloģisks pētījums uzrādīja, ka Latvijas iedzīvotāju zināšanas un prasmes joprojām ir relatīvi vājas (interneta aptauja ar 1010 respondentiem no visas Latvijas vecumā no 18 līdz 74 gadiem). Tikai 42% aptaujāto Latvijas iedzīvotāju zina, kas ir dziļviltojums un kā tas darbojas internetā, kā arī 27% domā, ka ir ar tādiem jau saskārušies. Vienlaikus tikai nedaudz vairāk kā trešdaļa (36%) respondentu uzskata, ka spētu atpazīt dziļviltojumu, tostarp no tiem tikai 9% jūtas pilnīgi droši.

Jāatceras, ka tas ir pašvērtējums, un tradicionāli uz līdzīgiem jautājumos cilvēki atbild, lai radītu par sevi, iespējams, labāku priekšstatu nekā patiesībā, bet nevar arī noliegt, ka ievērojama daļa sabiedrības vismaz par šiem izaicinājumiem informatīvajā telpā ir aizdomājušies. Bažas raisa trešdaļa respondentu, kuriem bija grūti atbildēt uz šo jautājumiem, kas ļauj pieņemt, ka ievērojamai daļai sabiedrības nemaz nav zināšanu, kas tas tāds “dziļviltojums” vispār ir.

Juridiskie izaicinājumi dziļviltojumu regulēšanai

Ņemot vērā, ka sintētiskais saturs kļūst arvien pieejamāks, tā radīšana vienkāršāka un pielietojums arvien intensīvāks, pieaug arī potenciāls, ka šāds saturs tiks izmantots ļaunprātīgiem mērķiem, piemēram, krāpniecībai, neslavas celšanai, šantāžai, kā arī dezinformācijai un informācijas ietekmēšanas operācijām. Tas rada arī nopietnus juridiskus izaicinājumus, kas ietver gan jau esošā regulējuma un likumu adaptāciju, gan, iespējams, jaunu normatīvu radīšanu. Tāpat nepieciešama izmeklētāju, prokuroru un tiesnešu, kā arī plašākas sabiedrības izglītošana par tehnoloģiju radītajām iespējām un riskiem. Vienlaikus jāveicina ciešāka sadarbība starp valsti un sociālo mediju platformām.

Jāatzīmē, ka lielākie mākslīgā intelekta (MI) uzņēmumi jau laikus sāka strādāt pie pašregulācijas un ierobežojumiem pašu radīto tehnoloģiju izmantošanā. Piemēram, DALL-E attēlu ģenerēšanas rīkam ir aizliegts attēlot politiķus un citas publiskas personas pretrunīgi vērtējamās situācijās vai izgatavot “lielu daudzumu politiskās kampaņas materiālu”. Midjourney lietošanas noteikumi nav tik strikti vai ierobežojoši, tomēr arī tie liedz ģenerēt saturu, kas izmantojams “musināšanai pret slavenībām”, tostarp politiķiem. Tomēr uz industrijas uzņēmumu ētiskumu, atbildību, pašregulāciju un vēlmi pašiem sev uzlikt ierobežojumus vai gūt peļņu dažādu iemeslu dēļ pārlieku nevajadzētu paļauties.

Jau ilgstoši Eiropas Savienība strādā pie digitālā tirgus drošības jautājumu sakārtošanas, tostarp ar regulācijas instrumentiem. Starp aktuālajiem regulācijas instrumentiem jāmin (Digital Markets Act – angļu val.), kas jau ir spēkā. Digitālo pakalpojumu akts nodrošinās, ka internets ES iedzīvotājiem kļūs drošāks, jo lielajiem tehnoloģiju uzņēmumiem, tostarp populārākajām sociālo mediju platformām, cita starpā būs pienākums cīnīties ar dezinformācijas, nelegāla satura un nedrošo produktu izplatību. Dalībvalstu institūcijām un arī katram iedzīvotājam būs iespēja vērsties ar ziņojumu digitālajās platformās, lai noņemtu nelikumīgu saturu.

Valsts kancelejas StratCom komandas pieredze, ziņojot sociālo mediju platformām par identificētajiem iespējamiem apzinātas maldināšanas gadījumiem, liecina, ka sociālo mediju platformas saskaras ar sistēmiskām problēmām. Tas attiecas gan uz lietotāju iesniegto ziņojumu par neadekvātu rīcību platformā izskatīšanu, kur lielā mērā darbs sociālo mediju platformu pusē ir nodots automatizētām sistēmām, tostarp MI, gan attiecībā uz ātrumā, kādā platformas sniedz slēdzienu un pieņem attiecīgus mērus par iesniegtajiem ziņojumiem. Samērā bieži platformu reakcija ir novēlota, un tas bieži noved pie tā, ka dezinformācija vai krāpniecisks saturs paspēj “izdzīvot” pietiekoši ilgi, lai nodarītu kaitējumu.

Svarīga loma gan šobrīd, gan turpmāk būs pašām ES dalībvalstīm un to kompetentajām institūcijām, kurām jāvāc informācija un dati, lai Eiropas Komisijai, kas uzrauga DSA regulas ievērošanu, būtu pamats pieprasīt sociālo mediju platformām nepilnības novērst.

Svarīgi funkciju veiks “uzticamie ziņotāji” (trusted flaggers – angļu val.), kuriem jaunajā regulējumā ir vēl lielāka loma un arī zināmas tiesības sadarbībā ar tehnoloģiju uzņēmumiem. “Uzticamo ziņotāju” programmas atsevišķās sociālo mediju platformās pastāvēja arī iepriekš, bet līdz ar jauno ES regulējumu šis process ir formalizēts un konkretizēts. Tādiem tehnoloģiju uzņēmumiem kā META un Google ir pienākums sadarboties ar ES dalībvalstu atbildīgajām institūcijām, lai novērstu kaitnieciska un nelegāla satura izplatību. Ne mazāk svarīga ir arī lielāka sociālo mediju platformu algoritmu uzraudzība un aizliegums reklāmas mērķēt nepilngadīgām personām.

Savukārt ES Digitālo tirgu akts liek tehnoloģiju uzņēmumiem kļūt vēl atvērtākiem. Kā piemēru var minēt tā sauktās “Atklātības sadaļas”, kas dod iespēju Google un Facebook platformās izvietotajām reklāmām jebkuram lietotājam noskaidrot, kurš ir maksājis par reklāmu digitālajā vidē.

Nākamais rindā ir Mākslīgā intelekta akts (AI Act – angļu val.), kurā definēti konkrēti standarti un prasības MI tehnoloģiju izstrādei un ar to saistīto pakalpojumu sniegšanai. Iecerēts, ka regulējums nodrošinās MI sistēmu drošību un atklātību, vienlaikus aizsargājot cilvēku pamattiesības. Politisko procesu vērotāji norāda, ka ir redzama spēcīga politiskā griba šo regulējumu ieviest. Tā apspriešanā 2023. gada 9. decembrī ir veiksmīgi noslēdzies trīspusējo sarunu pēdējais cikls, kas ļauj cerēt, ka Eiropas Parlaments par minēto regulu varētu nobalsot jau š.g. martā un tā varētu stāties spēkā vēl līdz Eiropas Parlamenta vēlēšanām 2024. gada jūnijā (lai gan ir plānots, ka šīs regulas piemērošana sāksies divus gadus pēc tās spēkā stāšanās).

Starp nozīmīgākajiem jaunā MI akta punktiem jāmin:

- Risku kategorizēšana: akts kategorizē dažādas MI sistēmas atkarībā no to radītā riska līmeņa. Dziļviltojumu tehnoloģijas, kas varētu tikt izmantotas ļaunprātīgi, varētu tikt iekļautas augsta riska kategorijā. Tas nozīmē, ka uz šādām sistēmām attieksies stingrāki regulējumi.

- Atklātības prasības: uzsvērta atklātības nepieciešamība, kas ir īpaši svarīgi dziļviltojumu gadījumā. Tas nozīmē, ka lietotājiem ir jābūt informētiem, ja tiek izmantots MI radīts sintētiskais saturs.

- Datu aizsardzība un privātums: MI sistēmām būs jānodrošina augsts datu aizsardzības līmenis, kā arī jāspēj nodrošināt, ka MI tehnoloģija nevar izmantot, lai pārkāptu indivīdu tiesības uz privātumu.

- Lietotāju aizsardzība: MI akts aizsargās lietotājus no potenciāli kaitīgu AI sistēmu ietekmes, kas ir īpaši svarīgi, ja runa ir par dziļviltojumu izmantošanu ļaunprātīgiem nolūkiem. Aizliegta būs tāda MI tehnoloģijas izstrādāšana vai pielietošana, kas saistīta ar cilvēku manipulēšanu un ietekmēšanu.

Tāpat kā Digitālo pakalpojumu un Digitālo tirgu aktos, arī Mākslīgā intelekta akta ievērošanu uzraudzīs Eiropas Komisija, kas izmeklēs iespējamos pārkāpumus un varēs sodīt uzņēmumus ar prāvām soda naudām – līdz pat 7% no uzņēmuma gada apgrozījuma. Gan tehnoloģiju izstrādātāji kā OpenAI, gan sociālo mediju un video koplietošanas platformas apzinās risku un jau sākuši strādāt pie lietošanas noteikumiem, kas ierobežos MI tehnoloģijas izmantošanu ļaunprātīgiem nolūkiem, kā arī ievieš sistēmas ar mērķi automatizēt iespējamo pārkāpumu novēršanu. Viens no pirmajiem pārbaudījumiem ES regulējuma efektivitātei būs iejaukšanās risku demokrātiskos procesos novēršana pirms Eiropas Parlamenta vēlēšanām šī gada jūnijā.

Nedrīkst būt tā, ka viss ir “viltots”!

Mākslīgā intelekta tehnoloģija pati par sevi nav problēma. Tas ir tikai instruments. Kā savulaik cilvēks izgudroja automašīnu un masveidā aizstāja zirgus, tā šobrīd MI ļauj efektivizēt procesus, radīt saturu ātrāk un lētāk. Problēmas rada tehnoloģijas ļaunprātīga pielietošana, kas cilvēkiem, kas ir nodarbojušies ar melošanu un apzinātu maldināšanu, lai gūtu kādu labumu, ļauj to darīt vēl efektīvāk, radot papildu drošības riskus sabiedrībai.

Vienlaikus dziļviltojumu risku kontekstā daudzi neaizdomājas arī par paradoksālu situāciju – ne tikai kaut kas var tikt viltots, bet arī kaut kas īsts var tikt pasniegts kā viltojums. Iespēju, ka jebkuru nevēlamu informāciju var pasniegt kā manipulāciju vai viltojumu, varētu uzskatīt pat par lielāku problēmu nekā MI radītus viltojumus, jo tiek apšaubīta datos un zinātnē balstītas objektīvās informācijas pastāvēšana kā tāda. Tas ļauj Krievijas raķešu uzbrukumus slimnīcai Ukrainā pasniegt kā “izdomājumus”, Hamās veiktu civiliedzīvotāju nogalināšanu kā “cionistu melus”, videomateriālu ar politiķa pieņemtu kukuli kā “dziļviltojumu”. – “izdomājumi!”. Hamās nogalina civiliedzīvotājus – “cionistu meli!”. Dziļviltojumu tehnoloģijas pastāvēšana kā tāda, pat ne to pielietojums konkrētajā situācijā, ļauj manipulatoriem izvairīties no atbildības un neitralizēt pretreakciju.

Diemžēl nav viegla veida, kā sevi pasargāt. Pats svarīgākais ir apzināties, ka dziļviltojumi pastāv un tie var tikt vērsti pret tevi. Mums pašiem jābūt pietiekoši atbildīgiem, lai nekļūtu par upuri, kas nozīmē, ka jāmācās uzlabot sava, un ideālā gadījumā jāpalīdz veicināt citu cilvēku, medijpratība, digitālā pratība un kritiskās domāšanas spējas.

- Jābūt skeptiskam, kas nozīmē, ka nedrīkst uzticēties visam, ko tu redzi sociālajos medijos vai internetā. Vienlaicīgi ir svarīgi iemācīties, kā veselīgi balansēt starp skepsi un uzticēšanos.

- Pielieto metodes, kas pārbaudītas un palīdz nekļūt par dezinformācijas upuri, proti, pārbaudi avotu un informāciju, meklējot to citos avotos.

- Jāmācās, kā pazīt viltojumus, kā novērtēt ticamību, kā nekļūt par krāpšanas upuri. Dziļviltojumi kļūst arvien labāki, bet dažreiz ir detaļas un nepilnības, kas atklāj to, ka tas ir viltojums. Piemēram, kroplības kakla rajonā vai roku pirkstos. Attēls dažkārt var šķist pārāk perfekts, “nopulēts” vai tā teikt episks, bet video pārāk pikseļains. Dziļviltojumu video dažkārt atklāj savas nepilnības, kad tie tiek skatīti pa kadriem. Atceries, ka ir svarīgi pastāstīt arī citiem, kad esi atpazinis dziļviltojumu.

- Samazini savu digitālo pēdu, lai būtu pēc iespējas mazāk brīvi pieejamas informācijas par tevi, tostarp fotoattēlu.

- Vienmēr esi uzmanīgs, kad kāds tev jautā naudu. Pat situācijās, kad tev to prasa tavi draugi vai radinieki, sūtot balss ziņas, sūtot video vai sazvanoties videozvanā. Lai no šādām krāpniecībām izvairītos, var laicīgi vienoties par paroli, kuru zini tikai tu un tavi tuvākie.

- Galu galā jāpieņem un jācenšas sadzīvot arī ar domu, ka, iespējams, uz dziļviltojumu kādreiz uzķersies arī pats, jo neviens nav perfekts. 😉

Ja uzskati, ka spēj atšķirt viltotu no īsta, tad pamēģini izpildīt šo testu.

Ar citiem šīs sērijas rakstiem vari iepazīties šeit:

👉Dziļviltojumi: digitālās patiesības un sintētiskie maldi – I daļa (21.12.2023.)

👉Dziļviltojumi: Digitālās patiesības un sintētiskie maldi – II daļa (27.12.2023.)

❗ Atceries par iespēju ziņot par manipulācijām informatīvajā telpā vietnē www.melnsuzbalta.lv!

👇 Noskaties Melu mednieku video par to, kā pasargāt sevi no dziļviltojumiem 👇