Pēdējo gadu laikā līdz ar sociālo mediju lietojuma pieaugumu sabiedrībā, aktivizējušies troļļi, boti un aktīvisti, kas raksta provokatīvus komentārus, izplata melus, ģenerē krāpnieciskas reklāmas kampaņas un vilto saturu. Šīs darbības sagādā galvassāpes ne vien sociālo mediju platformu administratoriem, bet arī valstu valdībām, medijiem un faktu pārbaudītājiem, jo efektīvu instrumentu šo manipulatīvo metožu pilnīgai izskaušanai joprojām nav.

Arvien plašākas iespējas manipulatoriem sniedz mākslīgais intelekts (MI), kas, balstoties uz lietotāja ievadītiem kritērijiem, spēj radīt sintētisku saturu, prognozēt un ietekmēt fizisko vai virtuālo vidi. Šajā rakstā sniedzam praktiskus padomus, ko ņemt vērā pirms Eiropas Parlamenta vēlēšanām, tostarp pēc kādām pazīmēm atpazīt tādas arvien izmantotākas un pieejamākas manipulācijas metodes kā botus, troļļus un dziļviltojumus.

Kas apdraud Eiropas Parlamenta vēlēšanas?

Atsevišķu ES dalībvalstu pieredze liecina, ka MI tehnoloģijas jau tikušas izmantotas, lai ietekmētu vēlētāju viedokli. Piemēram, 2023. gada rudenī Slovākijas parlamenta vēlēšanās fiksēts gadījums, kad pret politiskajiem konkurentiem izmantots dziļviltojums (audioieraksts ar it kā notikušu sarunu starp žurnālisti un politiķi, ar kuru sociālajos medijos aktīvi dalījās politiskie pretinieki). Lai arī tā bija viena epizode ilgstošā kampaņā informatīvajā telpā, Slovākijā vēlēšanās uzvarēja prokrieviskie spēki. Kā reiz Kremļa iespējamie centieni ietekmēt vēlēšanas ir lielākais drošības risks, no kā baidās Eiropas politiķi, jo Krievijas ietekmes palielināšana Briselē un ES dalībvalstu šķelšana gan savstarpēji, gan valstu iekšienē ir būtisks Kremļa mērķis savu ģeopolitisko ambīciju īstenošanā.

Sabiedrībai jābūt gatavai, ka pastāv teorētiski riski, ka pēdējās dienās pirms vēlēšanām vai pašā vēlēšanu dienā internetā un sociālo mediju platformās var parādīties diskreditējoša informācija, baumas, meli vai “sensācijas”’ nolūkā ietekmēt vēlētāju vēlmi piedalīties vēlēšanās vai to rezultātus. Tostarp iespējama vēlēšanu sistēmas apšaubīšana, viltus aptauju izplatīšana, arī vēlētāju aktivitātes ietekmēšana, kādas sabiedrības grupas atturot, kamēr citas grupas stimulējot doties balsot.

Ietekmēšanas metodes internetā un sociālajos medijos

Boti jeb roboti sociālo mediju platformās ir automatizēti vai daļēji automatizēti konti, kas var veikt ierakstus, pārpublicēt ierakstus, atzīmēt “Patīk”, sekot citiem kontiem, pārtraukt sekošanu, sūtīt ziņojumus citiem platformas lietotājiem. Botus arī izmanto, lai manipulētu ar sabiedrisko domu, padarot noteiktas balsis skaļākas un nomācot citas. To sauc par astroturfingu.

Troļļi ir lietotāju konti, ko izveidojuši un vada īsti cilvēki vai datorprogrammas, kuru mērķis ir radīt apjukumu ar pārlieku lielas informācijas, tostarp dezinformācijas, palīdzību. Troļļu tīkli, tāpat kā boti, tiek veidoti, lai informatīvajā telpā radītu viltus ilūziju, ka kāds viedoklis sabiedrībā ir ļoti populārs un apspriests, kaut arī patiesībā tā nemaz nav. Troļļi nav racionāli, to uzdevums ir maldināt, sēt šaubas, radīt apjukumu vai sasniegt citus mērķus. Bieži to mērķis ir nozagt laiku, ievilkt jūs bezjēdzīgās diskusijās, izsaukt jūsos konkrētas emocijas un sajūtas, tostarp dusmas, bailes vai nomāktību.

Dziļviltojums ir mākslīga intelekta (MI) pilnībā ģenerēts vai ar MI manipulēts attēls, audio vai video saturs, kurš atgādina reālas personas, priekšmetus, vietas vai notikumus, kas apzināti radīts, lai maldinātu personu, cenšoties radīt ilūziju, ka sintētiski radītais saturs ir autentisks vai patiess. Bieži dziļviltojuma radītāji apzināti slēpj pēdas, lai auditorija nevarētu saprast, ka produkts radīts ar MI.

Kā tos atpazīt?

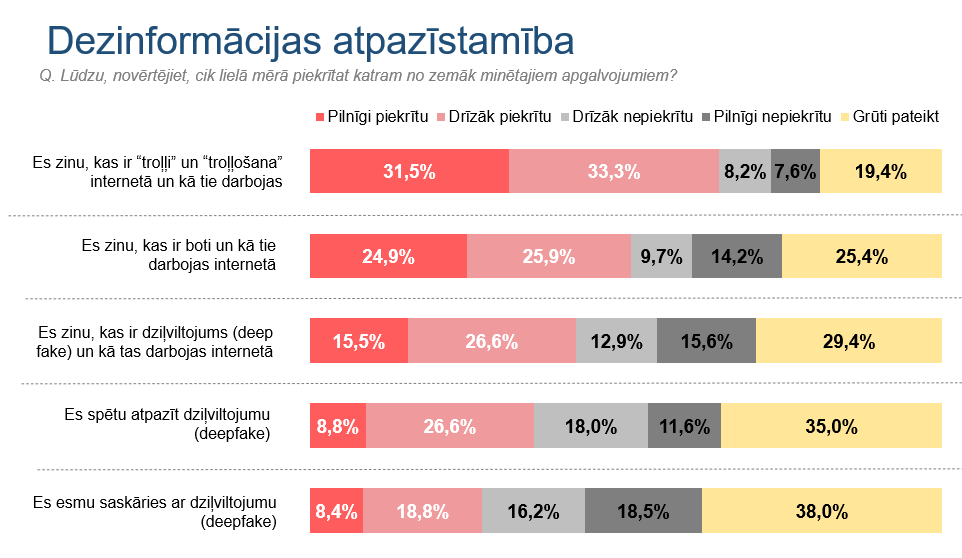

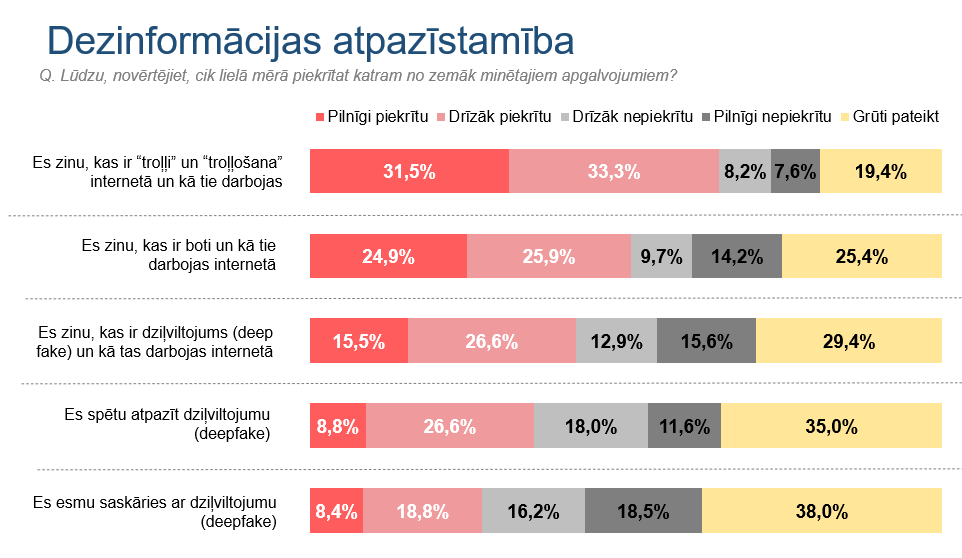

Latvijas iedzīvotāju spējas atpazīt botus, troļļus un dziļviltojumus kopumā vērtējamas kā vājas vai labākajā gadījumā viduvējas – to apliecina Valsts kancelejas uzdevumā veikts Latvijas iedzīvotāju pētījums 2023. gada oktobrī un novembrī. Troļļus un troļļošanu internetā atpazīst un saprot, kā tie darbojas internetā vien nepilni 65% respondentu. Par botiem un dziļviltojumiem informēti un spējīgi tiem pretoties ir vēl mazāk cilvēku. Piemēram, savas spējas atpazīt dziļviltojumu pašvērtējumā droši atzina vien 35% respondentu.

Atpazīt botus un troļļus sociālajos medijos var pēc virknes pazīmju, tostarp šos kontus nereti raksturo:

- animētas, neīstas vai zagtas profilu bildes (par to var pārliecināties ar apgriezto attēlu meklēšanu);

- lietotāja konta nosaukumā var būt automatizēti veidoti skaitļu un burtu virknējumi,

- botu un troļļu ierakstiem mēdz būt ļoti liels skaits dalīšanos (shares), bet maz emocijzīmju (like);

- ieraksti nereti ir pavirši, ar latviešu valodas gramatikas kļūdām;

- ierakstu saturs bieži ir provokatīvs, valdību, valsts institūcijas vai kādu notikumu vai personu kritizējošs;

- kontu izplatītais saturs pastiprina vai slāpē konkrētas interešu grupas pozīciju sabiedrībā.

2024. gadā fiksēti jau vairāki gadījumi, kad sociālajos medijos izplatīta uz Latvijas auditoriju vērsta botu aktivitāte. Piemēram, februāra izskaņā pēc Latvijas Hokeja federācijas lēmuma anulēt licences Latvijas hokejistiem, kas Krievijā piedalījās tā saucamajās “Nākotnes spēlēs”, pret Latviju tika vērsta liela mēroga botu operācija. Kā uzskata Kremļa botu pētnieku projekts “Bot Blocker (@antibot4navalny), operācija nāca no prokremliska Doppelgänger / RRN robotu tīkla. Ar botu tīkla palīdzību masveidā tika izplatīts naratīvs par “sportistu sodīšanu” un vilšanos Latvijas Hokeja federācijā, aicinot nejaukt sportu ar politiku.

Līdzīga botu aktivitāte tika piedzīvota šī gada maijā, kad boti no Doppelgänger tīkla koordinēti izplatīja video vairākās valstu auditorijām, tostarp Latvijā, kurā izsmēja ASV prezidentu Džo Baidenu kontekstā arī šī gada rudenī plānotajām ASV prezidenta vēlēšanām. Video rādīta it kā krāpnieciska balsu skaitīšana, izsmiets ASV prezidenta vecums un viņa vadītās administrācijas imigrācijas politika.

Dziļviltojumu atpazīšana ir sarežģītāka, bet ne neiespējama

Par dziļviltojumiem un pazīmēm, pēc kurām tos atpazīt, esam rakstījuši arī iepriekš rakstu sērijā “Dziļviltojumi: digitālās patiesības un sintētiskie maldi” (I daļa, II daļa, III daļa). Šoreiz pievēršamies praktiskiem padomiem, kam pievērst uzmanību, lai noteiktu, vai saturs ir autentisks vai radīts, lai, iespējams, jūs maldinātu un ietekmētu jūsu izvēles, tostarp Eiropas Parlamenta vēlēšanās.

Pirmkārt, sastopoties ar iespējamu dziļviltojumu, būtiski ir saglabāt veselo sapratu un vēsu galvu. Ieteicams saglabāt veselīgu skepsi pret jebkādiem emocionāli pielādētiem, skaļiem, sensacionāliem vai tendencioziem paziņojumiem, virsrakstiem un audiovizuālo saturu, kas tiek “iepludināts” informatīvajā telpā īsi pirms vēlēšanām, vēlēšanu dienā vai īsi pēc tās. Tāpat kā citu informācijas manipulācijas metožu gadījumā, arī iespējamo dziļviltojumu gadījumā strādā tās metodes, lai noteiktu satura autentiskumu, tostarp:

- pārliecinies, vai par šo saturu/ notikumu vēsta Latvijas vai starptautiskie tradicionālie mediji, vai tie ir uzticami mediji, vai norādīti žurnālistu vārdi, uz kādiem avotiem viņi atsaucas;

- pārbaudiet, vai saturs jau nav nonācis neatkarīgo faktu pārbaudītāju redzeslokā un kāds ir viņu atzinums;

- izpētiet, cik ticams ir satura avots – konta autentiskums, izveidošanas laiks, pārējais tā izplatītais saturs, komentāru sadaļa.

Otrkārt, atpazīsti ar MI radītus vai manipulētus attēlus un videomateriālus pēc konkrētām pazīmēm:

- neparasts kadru krāsojums;

- kļūdainas ēnas vai to trūkums;

- noraustīšanās pārejās starp kadriem;

- kļūdainas vai kropļotas cilvēku un aksesuāru detaļas (halucinācijas): acis, ausis, pirksti, zobi, rotaslietas, brilles, matu sakārtojums un citi;

- slikta sinhronizācija starp attēlu un skaņu (noraustīšanās).

Treškārt, ar MI radītus audiomateriālus var atpazīt pēc šādām pazīmēm:

- skaņas materiālā ir nepareizi lietoti vai starp vārdiem nesaskaņoti latviešu valodas locījumi;

- ieturētas savādas pauzes starp vārdiem vienā teikumā vai starp teikumiem;

- runātājam ir neviendabīga intonācija, runa nav plūstoša.

Gan audiovizuālajos materiālos, gan rakstītos tekstos, piemēram, sociālo mediju ierakstos ar MI veidoti teksti bieži satur faktoloģiskas neprecizitātes. Tajos tāpat kā skaņas materiālā var būt nesakritības latviešu valodā starp vārdu locījumiem un galotnēm vai tie satur nepilnīgu un neticamu informāciju.

Ceturtkārt, pastāv vairāki tehniski rīki, kā identificēt un noteikt, ka saturs ir dziļviltojums vai radīts ar MI rīkiem:

- pievērs uzmanību birkām sociālajos medijos pie ierakstiem – vairākas sociālo mediju platformas jau ieviesušas brīdinājumus zem attēliem un videomateriāliem, ka saturs ir radīts ar MI rīkiem;

- audiovizuālo saturu ir iespējams pārbaudīt ar apgriezto meklēšanu, identificējot, kur konkrēts attēls ir publicēts iepriekš, tostarp kāds avots to ir publicējis vissenāk (video pamācība, kā izmantot Google Reverse Image Search);

- sociālo mediju platformas un lielie tehnoloģiju uzņēmumi ir apvienojušies, lai ieviestu digitālās ūdenszīmes ar MI radītos produktos, par ko jau ir vai tuvākajā nākotnē būs iespējams pārliecināties, izpētot potenciālo dziļviltojumu failu metadatus;

- izmanto kādu no internetā pieejamiem MI pārbaudes rīkiem, lai noteiktu, vai audiovizuālais saturs ir autentisks vai sintētiski radīts. Vienlaikus ņem vērā, ka šie rīki vēl nespēj nodrošināt viennozīmīgi drošu kvalitāti.

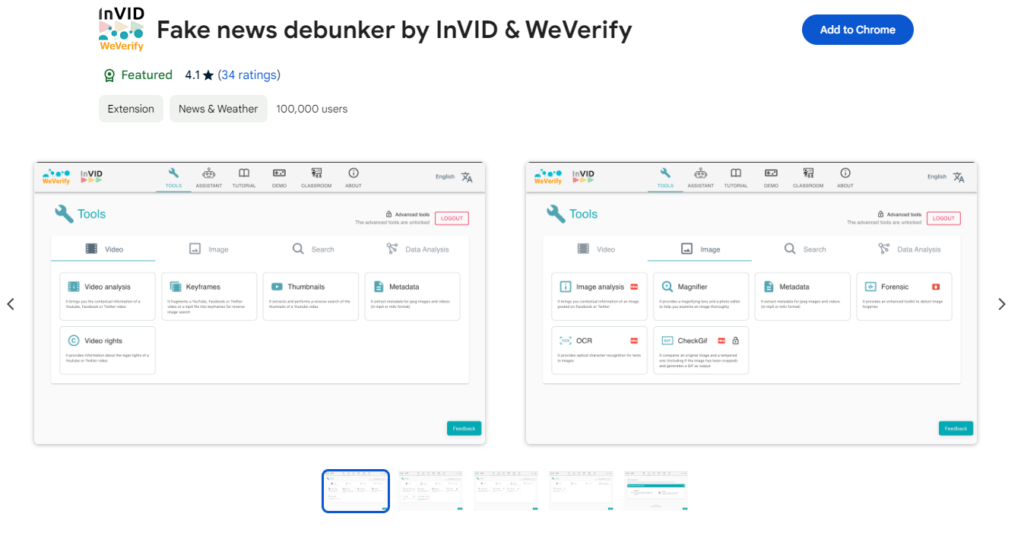

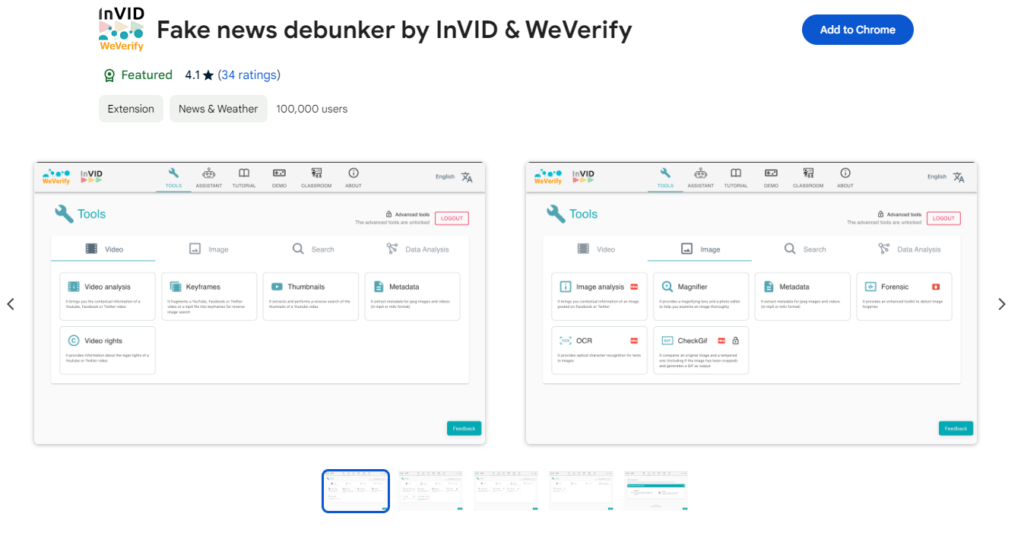

Populārāko MI radīta satura identificēšanas programmu vidū ir AI or NOT, kamēr, piemēram, We Verify pieejams gan MI pārbaudītājs, gan interneta pārlūka spraudnis. Arī Microsoft ir izstrādājis autentifikātoru, kas varētu veikt dziļviltojumu atpazīšanu, bet šāds rīks ir pieejams tikai izvēlētiem partneriem un nav pieejams publiski.

Paredzams, ka dziļviltojumu kvalitāte tuvākajā laikā turpinās uzlaboties, tāpat kā MI iespējas. Miljardieris Īlons Masks pat prognozējis, ka pēc diviem gadiem MI būs gudrāks par cilvēkiem. Tas nozīmē, ka mūsu ikdienā aizvien biežāk parādīsies saturs, par kura autentiskumu nevarēsim būt pilnībā droši. Tādēļ spēja atpazīt viltojumus līdzīgi kā lasīšana un rakstīšana kļūs par daļu no obligāti apgūstamo prasmju klāsta, lai nepazustu jaunāko tehnoloģiju piedāvātajās iespējās un neiekristu manipulatoru lamatās gan ikdienā, gan vēlēšanu laikā.

“Melns uz balta” komanda aicina iedzīvotājus būt vērīgiem Eiropas Parlamenta vēlēšanās un saglabāt veselīgu skepsi pret skaļiem, emocionāli pielādētiem, tendencioziem un skandaloziem pēdējā brīža paziņojumiem vai materiāliem informatīvajā telpā, lai neiekristu dezinformatoru izliktajos slazdos. Aicinām nepiedalīties viltotu materiālu vai naratīvu tālākā izplatīšanā. Par pamanītajiem aģitācijas pārkāpumiem ziņo kompetentajām iestādēm, tostarp par botiem, troļļiem un dziļviltojumiem ziņo arī mūsu komandai, izmantojot funkciju “Ziņo par dezinformāciju!” vietnē www.melnsuzbalta.lv.